“企业AI工具数据安全指南:你的数据到底去了哪里?”

1、引言

2026年,AI工具已经成为企业办公的「基础设施」。从代码编写到文档分析,从客服自动化到数据分析,大模型正在深刻改变企业的工作方式。

但一个根本性问题始终萦绕在企业决策者心头:我把数据交给AI工具,这些数据最终去了哪里?

国家安全部2026年初的警示案例已经说明:员工无意中向AI工具投喂敏感数据,导致数据泄漏的事件正在全球范围内频繁发生。

本文将深入分析企业常用的AI工具的数据安全特性,重点对比:

OpenAI官方API、OpenAI兼容API网关、本地部署的OpenClaw(龙虾)、以及云上版本的OpenClaw——这四类方案的数据安全差异,以及企业如何根据自身安全等级选择合适的方案。

2、企业AI工具的数据安全风险图谱

2.1 数据流向是核心问题

在讨论具体工具之前,需要先理解一个基本概念:你的数据去了哪里,取决于你使用的AI工具类型和服务部署方式。

大模型的数据安全风险主要来自三个维度:

数据存储风险:请求数据是否会被服务商存储?存储在哪里?存储多久?

数据使用风险:存储的数据是否会被用于模型训练?是否会被第三方访问?

数据传输风险:数据在传输过程中是否加密?是否经过第三方服务器?

2.2 四类主流AI工具的数据安全对比

根据数据流向和安全等级,企业常用的AI工具可以分为四个象限:

| 方案类型 | 数据流向 | 安全等级 | 适用场景 |

|---|---|---|---|

| OpenAI官方API | 数据出境 | 低 | 通用场景,需严格脱敏 |

| OpenAI兼容API(国内) | 数据留在国内 | 中 | 国内企业,敏感数据需审批 |

| OpenClaw本地部署 | 数据不出企业 | 高 | 金融、政务、高敏感行业 |

| OpenClaw云上版本 | 取决于部署位置 | 中-高 | 需看具体云服务商 |

3、OpenAI官方API:数据出境的核心风险

3.1 工作原理

OpenAI官方API是目前最成熟的AI开发接口,全球数百万开发者都在使用。其数据流向如下:

1 | 企业 → OpenAI服务器(美国) → 返回结果 |

3.2 数据安全风险

使用OpenAI官方API,数据会直接发送到OpenAI的服务器。根据OpenAI的服务条款:

存储风险:请求数据可能被存储在OpenAI服务器上,用于改善服务质量和模型训练(可通过设置ad hoc参数申请不用于训练,但并非绝对保证)。

合规风险:数据出境需要通过数据出境安全评估,国内企业和机构使用OpenAI官方API存在合规风险。

访问风险:在极端情况下(如法律要求),数据可能被政府或第三方访问。

3.3 企业使用建议

如果企业必须使用OpenAI官方API,建议:

- 严格数据脱敏:任何上传到OpenAI的数据必须经过脱敏处理,移除个人身份信息、商业机密、国家秘密等敏感内容

- 申请数据隔离:开启企业账户的数据隔离选项,减少数据被用于训练的风险

- 审计日志:建立完整的API调用日志,便于追溯数据流向

- 评估合规风险:咨询法务部门,评估数据出境的合规风险

4、OpenAI兼容API:数据留在国内

4.1 工作原理

OpenAI兼容API是指国内服务商提供的、接口格式与OpenAI兼容的大模型API服务。典型代表包括:

- 阿里云百炼:通义千问系列模型

- 硅基流动(SiliconFlow):聚合多个国内模型

- 百度智能云:文心一言系列

- 智谱AI:GLM系列

数据流向为:

1 | 企业 → 国内云服务商服务器 → 返回结果 |

4.2 数据安全优势

相比OpenAI官方API,国内兼容API有几大安全优势:

数据不出境:数据存储在国内服务器,不存在数据出境合规问题

合规更清晰:国内云服务商通常有完整的合规资质和安全保障

服务响应快:国内服务器延迟更低,响应速度更快

4.3 仍需注意的风险

虽然数据不出境,但使用国内兼容API仍需注意:

服务商访问风险:云服务商在技术上可以访问存储在其服务器上的数据

训练使用风险:部分服务商可能将数据用于模型优化,需确认服务条款

敏感数据审批:金融、政务、医疗等行业的高敏感数据使用仍需内部审批

4.4 企业使用建议

- 选择有保障的服务商:优先选择有数据安全认证(如ISO27001、等保认证)的服务商

- 确认数据使用条款:在使用前确认服务商不会将数据用于模型训练

- 开启私有部署选项:如阿里云百炼支持私有模型部署,数据完全隔离

- 建立调用审批流程:对涉及敏感数据的API调用建立审批机制

5、OpenClaw本地部署:数据不出的终极方案

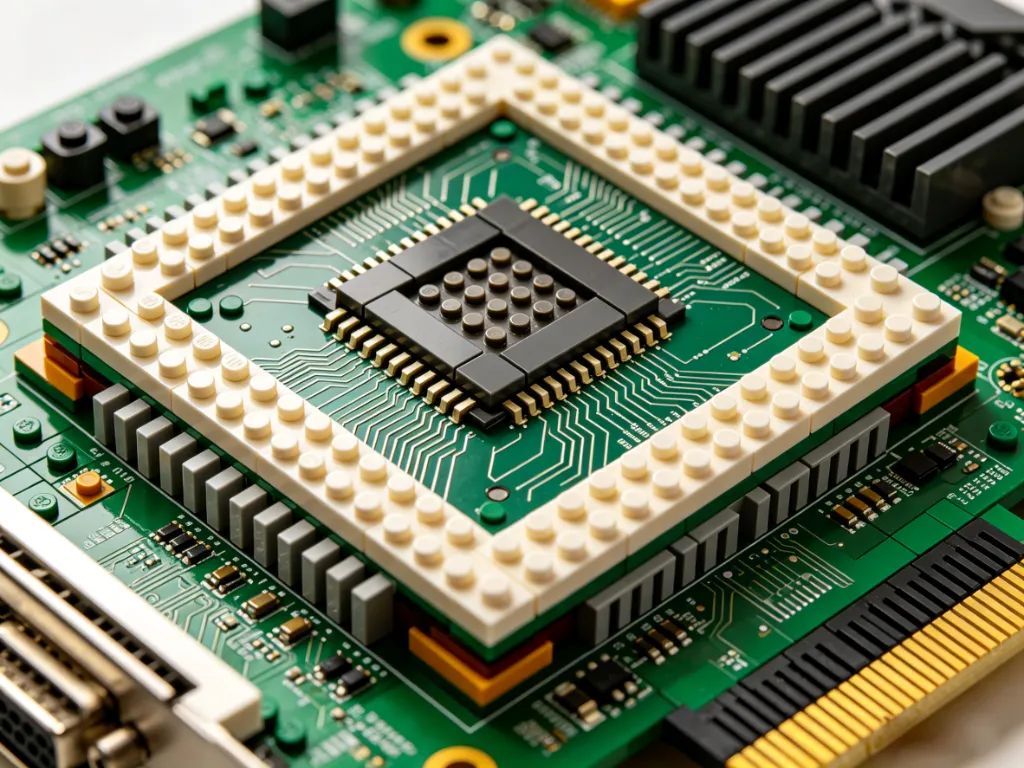

5.1 什么是OpenClaw(龙虾)

OpenClaw,中文昵称「小龙虾」,是一个开源、本地优先的AI智能体框架。它为大模型赋予「数字手脚」,支持自然语言驱动的端到端任务执行——操作电脑、处理文件、自动化办公流程等。

核心特点:

- 完全开源,可在GitHub获取源码

- 支持连接通义千问、Claude等主流大模型

- 插件生态丰富,支持网页操作、文件管理等

- 本地部署,数据完全不离开企业

5.2 本地部署的数据安全优势

OpenClaw本地部署是数据安全的终极方案:

数据完全不离开企业:所有AI处理都在企业本地服务器完成,没有任何数据外传

代码可审计:开源代码可以安全审计,确保没有后门或数据外泄

完全自主控制:企业拥有全部基础设施,可以实施任何安全策略

离线可用:在网络隔离环境下也能正常工作

5.3 本地部署的挑战

当然,本地部署也面临一些挑战:

部署复杂度:需要一定的技术能力进行部署和维护

硬件要求:运行大模型需要足够的GPU资源

维护成本:需要专业团队进行日常运维

模型能力受限:本地部署的模型能力取决于硬件配置

5.4 部署方案选择

OpenClaw支持多种本地部署方式:

| 部署方式 | 适用场景 | 硬件要求 |

|---|---|---|

| Windows WSL2 | 个人开发者、轻量使用 | 普通PC即可 |

| 私有服务器 | 中小企业 | 需要GPU服务器 |

| 容器化部署(Docker/K8s) | 中大型企业 | K8s集群 |

5.5 企业使用建议

- 评估安全需求:首先评估企业数据的敏感等级,确定是否需要本地部署

- 准备硬件资源:根据使用规模准备相应的GPU计算资源

- 建立安全规范:制定OpenClaw使用安全规范,包括可处理的敏感数据范围

- 定期安全更新:保持OpenClaw版本更新,及时修复安全漏洞

6、OpenClaw云上版本:灵活与安全的平衡

6.1 云上版本的价值

OpenClaw云上版本是介于完全本地部署和纯API调用之间的折中方案。

核心价值:

- 降低部署复杂度,无需自建基础设施

- 保持一定程度的灵活性

- 可根据需要选择部署位置(公有云/私有云/混合云)

6.2 数据安全的关键:部署位置

OpenClaw云上版本的数据安全取决于具体的部署位置:

公有云部署:

- 数据存储在云服务商服务器

- 优势:弹性扩展、快速部署

- 风险:与国内兼容API类似,存在服务商访问风险

私有云部署:

- 数据存储在企业自己的云环境

- 优势:数据可控,满足合规要求

- 风险:需要自建私有云环境

混合云部署:

- 敏感数据本地处理,非敏感数据云端处理

- 优势:灵活平衡安全与成本

- 挑战:架构复杂度较高

6.3 选择云服务商的关键考量

如果选择OpenClaw云上版本,选择云服务商时应关注:

- 数据中心位置:国内数据中心避免数据出境风险

- 安全认证:是否通过等保三级、可信云等认证

- 数据隔离:不同客户的数据是否真正隔离

- 合规资质:是否具备金融、政务等行业准入资质

7、企业AI数据安全架构设计

7.1 分级安全策略

企业应根据数据的敏感等级,设计分层的安全架构:

第一层:公开数据

- 新闻资讯、公开文档等

- 可使用任何AI工具,包括OpenAI官方API

- 无需特殊审批

第二层:内部数据

- 内部流程文档、一般性业务数据

- 建议使用国内兼容API

- 需要部门负责人审批

第三层:敏感数据

- 客户信息、财务数据、员工信息

- 建议使用OpenClaw本地部署

- 需要数据安全部门审批

第四层:核心机密

- 商业机密、核心技术、涉密信息

- 禁止使用任何外部AI工具

- 仅允许在完全隔离的内网环境中使用私有模型

7.2 AI网关架构

对于规模较大的企业,建议部署统一的AI网关:

功能设计:

1 | [企业应用] → [AI网关] → [路由分发] |

核心功能:

- 统一入口:所有AI调用通过网关接入

- 智能路由:根据数据类型自动选择合适的AI服务

- 审计日志:完整记录所有AI调用和数据流向

- 访问控制:基于角色的AI使用权限管理

- 敏感数据检测:自动识别并拦截敏感数据外传

7.3 数据安全技术措施

网络层面:

- 敏感数据外发AI服务时强制走加密通道

- 建立AI服务白名单,禁止访问未授权服务

- 部署DLP(数据防泄漏)系统监控AI数据流

应用层面:

- 在应用层实现数据脱敏

- AI调用前自动检测敏感信息

- 对AI返回结果进行安全审核

管理层面:

- 制定AI工具使用规范

- 定期安全培训

- 建立AI使用审计机制

8、不同规模企业的方案建议

8.1 小型企业(50人以下)

推荐方案:

- 主要使用国内兼容API(如阿里云百炼、硅基流动)

- OpenClaw本地部署作为辅助

- 评估后可有限使用OpenAI官方API(仅处理公开数据)

实施要点:

- 制定简单的AI使用规范

- 使用SaaS化的AI网关服务

- 定期培训员工数据安全意识

8.2 中型企业(50-500人)

推荐方案:

- 建立统一的AI网关平台

- 根据数据敏感度分流使用不同AI服务

- 核心业务系统使用OpenClaw本地部署

实施要点:

- 部署专业AI网关软件(如APIPark)

- 建立AI使用审批流程

- 组建数据安全团队进行日常监控

8.3 大型企业(500人以上)

推荐方案:

- 完整的AI安全架构设计

- 多层AI服务组合(本地+云+混合)

- 自建AI能力平台

实施要点:

- 建立AI治理委员会

- 实施数据分类分级管理

- 定期进行AI安全评估和渗透测试

9、结语

2026年,AI工具已经成为企业竞争力的关键组成部分。但AI带来效率提升的同时,数据安全风险也在同步放大。

企业不应该因为担心数据安全而放弃使用AI,但也不应该为了效率而忽视数据安全。答案在于:根据数据的敏感等级,设计分层的AI使用策略。

对于大多数国内企业而言:

公开数据用OpenAI,通用场景用国内API,核心业务用OpenClaw本地部署——这可能是一个务实的AI数据安全策略。

未来,随着AI技术的成熟和企业安全意识的提升,我们期待看到更多、更安全的AI使用方案出现。但在此之前,每一家企业都需要对自己的数据安全负责。